Vulnerabilidad en la IA: cómo manipular a ChatGPT y Gemini en 20 minutos

Descubre cómo un experimento reciente logró engañar a ChatGPT y Google Gemini en solo 20 minutos. Una guía sobre los riesgos de la desinformación en la IA en este 2026.

Descubre cómo un experimento reciente logró engañar a ChatGPT y Google Gemini en solo 20 minutos. Una guía sobre los riesgos de la desinformación en la IA en este 2026.

La desconfianza en la privacidad y el rendimiento superior de Claude 3.5 Sonnet están provocando un éxodo masivo de usuarios desde ChatGPT hacia Anthropic en este inicio de 2026.

Instagram implementa Shop the Look, una IA que añade botones de compra automáticos en posts ajenos. El comercio social sacrifica al creador en el altar de la eficiencia de Meta.

La Corte Suprema de EE. UU. cierra la puerta a la protección por copyright del arte generado por IA, reafirmando que solo los humanos pueden ser autores legales en la era digital.

La startup china DeepSeek lanza su modelo V4 este 2 de marzo de 2026. Analizamos este avance multimodal y los riesgos que supone para tu privacidad y la seguridad global.

Claude alcanza el número uno en la App Store tras rechazar el uso de su IA en armas del Pentágono. La ética gana usuarios, pero los fallos de servicio ponen a prueba su infraestructura.

La programación manual está muriendo. En su lugar nace la habilidad agéntica: la capacidad de dirigir ejércitos de IA para construir sistemas complejos sin escribir una sola línea de código.

Descubre cómo opera el fraude de los likes en redes sociales, la técnica de manipulación que vacía cuentas bancarias bajo la promesa de un sueldo fácil por tareas simples.

Descubre cómo Alinia está instalando frenos de emergencia en la inteligencia artificial para evitar errores críticos en la banca y la salud. Seguridad real para un mundo digital impredecible.

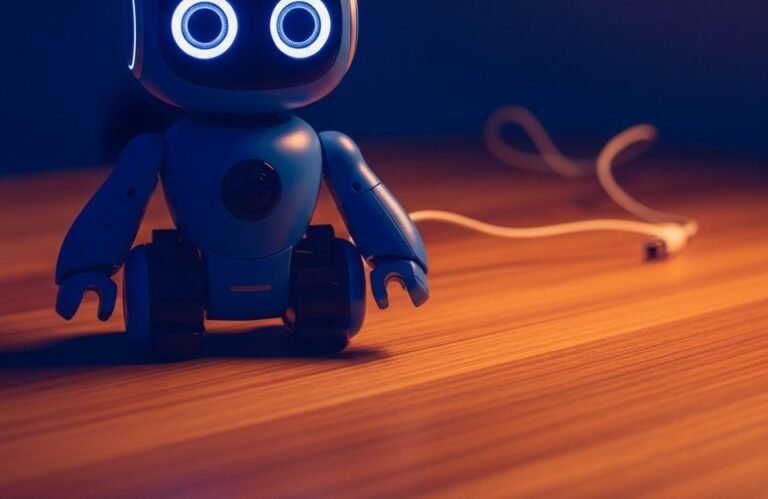

Descubre cómo el diseño tierno de los robots modernos es una táctica psicológica para que ignoremos los riesgos de privacidad y entreguemos nuestros datos personales sin sospechar.