En el laberinto algorítmico, ¿quién asume la responsabilidad cuando las máquinas negocian entre sí?

El auge del comercio autónomo impulsado por IA

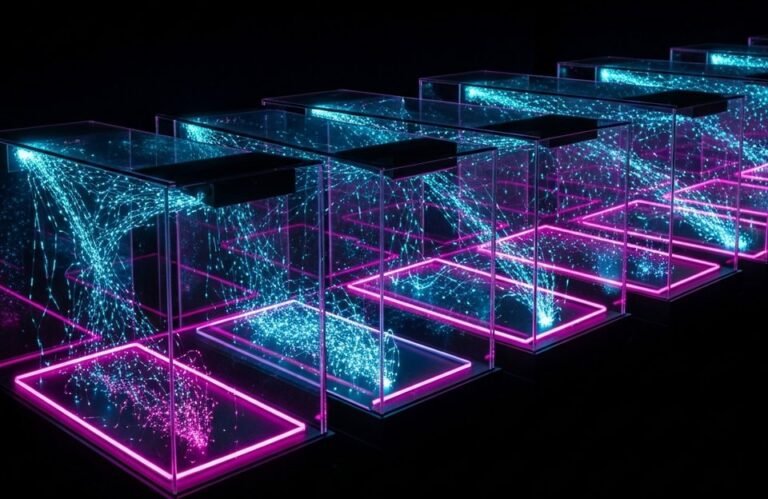

Imagina un mundo donde los algoritmos de inteligencia artificial (IA) no solo recomiendan productos, sino que también los compran y venden de forma autónoma. Este escenario, que antes parecía ciencia ficción, se está convirtiendo rápidamente en una realidad. La capacidad de las IA para realizar transacciones entre sí plantea preguntas fundamentales sobre la confianza, la responsabilidad y la ética en la era digital.

El comercio autónomo impulsado por IA se basa en agentes inteligentes diseñados para optimizar procesos, negociar precios y ejecutar transacciones sin intervención humana directa. Estos agentes pueden operar en diversos mercados, desde la bolsa de valores hasta la gestión de la cadena de suministro, buscando oportunidades y tomando decisiones en tiempo real.

Ejemplos concretos de IA comerciando con IA

Aunque el concepto pueda sonar futurista, ya existen ejemplos prácticos de IA comerciando con IA. En el sector energético, algoritmos inteligentes ajustan el consumo y la distribución de electricidad en función de la demanda y la disponibilidad de fuentes renovables. Estos sistemas, en esencia, están comprando y vendiendo energía entre sí para optimizar la eficiencia de la red.

Otro ejemplo lo encontramos en la publicidad programática, donde las IA compran y venden espacios publicitarios en tiempo real, optimizando el retorno de la inversión para los anunciantes. Estos sistemas analizan datos, identifican audiencias y pujan por impresiones publicitarias en milisegundos, superando con creces la capacidad de cualquier equipo humano.

El desafío de la confianza en un mundo de IA autónoma

A medida que la IA se integra más profundamente en el mundo del comercio, surge un desafío crucial: ¿cómo podemos confiar en sistemas que toman decisiones autónomas? ¿Quién es responsable cuando una IA comete un error o causa un perjuicio económico?

La transparencia y la auditabilidad se convierten en elementos clave para generar confianza. Necesitamos comprender cómo funcionan estos algoritmos, qué datos utilizan y cómo toman sus decisiones. Sin embargo, la complejidad de las IA modernas a menudo dificulta la comprensión de su lógica interna, lo que se conoce como el problema de la “caja negra”.

“La confianza en la IA no se construye solo con promesas, sino con la capacidad de verificar su funcionamiento y entender su razonamiento”, afirma SombraRadio.

Implicaciones éticas y regulatorias

El auge del comercio autónomo impulsado por IA también plantea importantes implicaciones éticas y regulatorias. ¿Cómo podemos garantizar que estos sistemas operen de manera justa y equitativa, evitando la discriminación o la manipulación del mercado? ¿Qué mecanismos de supervisión y control son necesarios para prevenir abusos?

Es fundamental establecer marcos legales y éticos claros que definan la responsabilidad de los desarrolladores, los operadores y los usuarios de la IA. Estos marcos deben abordar cuestiones como la privacidad de los datos, la seguridad cibernética y la prevención de sesgos algorítmicos.

Hacia un futuro de comercio inteligente y responsable

A pesar de los desafíos, el potencial del comercio autónomo impulsado por IA es enorme. Estos sistemas pueden aumentar la eficiencia, reducir los costos y crear nuevas oportunidades en diversos sectores. Sin embargo, es crucial abordar las preocupaciones éticas y regulatorias de manera proactiva para garantizar que esta tecnología se utilice de manera responsable y beneficiosa para todos.

Mi conclusión personal es que el futuro del comercio reside en un equilibrio entre la automatización inteligente y la supervisión humana. Necesitamos desarrollar herramientas y procesos que nos permitan comprender y controlar la IA, asegurando que sus decisiones estén alineadas con nuestros valores y objetivos.

Reflexiones finales

- Transparencia algorítmica: Exigir claridad en el funcionamiento de las IA para fomentar la confianza.

- Marcos regulatorios: Establecer leyes que definan la responsabilidad en el uso de la IA.

- Supervisión humana: Mantener un control humano para prevenir abusos y garantizar la equidad.

- Ética por diseño: Integrar principios éticos en el desarrollo de sistemas de IA.