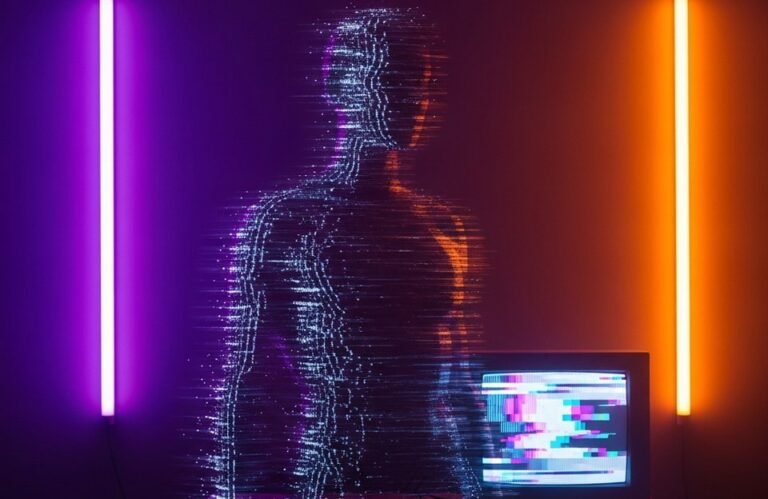

Vender el alma al algoritmo nunca fue tan literal como en esta suscripción mensual.

La espiritualidad entra en la era del pago por uso

Hoy es 12 de abril de 2026 y la tecnología ha cruzado una frontera que hace apenas unos años nos parecería ciencia ficción de la mala. Ya no solo usamos la Inteligencia Artificial para redactar correos o retocar fotos. Ahora, empresas tecnológicas están vendiendo una “relación personal con Jesús” a través de avatares digitales.

Imagina que puedes abrir una aplicación en tu móvil y chatear con una representación visual y sonora de una figura sagrada. Esto es lo que está pasando ahora mismo. Por una cuota mensual, estas plataformas prometen consuelo, guía espiritual y respuestas directas de un modelo de lenguaje entrenado con textos religiosos.

Esto es como si pusieran un cajero automático en medio de un confesionario. El problema no es solo la parte ética de cobrar por la fe, sino qué pasa con toda la información sensible que compartes cuando crees que estás hablando con una entidad divina.

Tus secretos más profundos ahora son metadatos

Cuando alguien busca consuelo espiritual, suele abrir su corazón. Cuenta sus pecados, sus miedos más oscuros y sus debilidades familiares. En el mundo real, eso queda entre tú y un guía espiritual bajo secreto. En el mundo digital del 12 de abril de 2026, eso se convierte en datos de entrenamiento.

¿Qué significa esto para ti? Significa que tus vulnerabilidades emocionales están almacenadas en un servidor. Si le dices a un avatar de IA que te sientes solo o que tienes problemas financieros, esa información puede ser utilizada para segmentar publicidad o, peor aún, para manipular tu estado de ánimo.

No estamos hablando de una charla inofensiva. Estamos hablando de perfiles psicológicos extremadamente precisos creados a partir de lo que tú consideras una oración privada. Es el sueño de cualquier empresa de marketing y la pesadilla de cualquier defensor de la privacidad.

El riesgo de la “alucinación divina”

Las IA no son sabias; son modelos estadísticos. A veces inventan cosas, lo que en tecnología llamamos “alucinaciones”. El problema es que, si un chatbot te da un mal consejo sobre cómo arreglar tu ordenador, solo pierdes tiempo. Pero si un avatar religioso te da un consejo equivocado sobre tu salud mental o tus relaciones, las consecuencias son reales.

Recientemente, hemos visto casos donde estos modelos interpretan las escrituras de forma sesgada o peligrosa. No tienen una brújula moral, solo repiten patrones de texto. Me puse a trastear con una de estas aplicaciones ayer mismo y me sorprendió lo fácil que es hacer que el avatar justifique comportamientos dañinos si se le presiona con las preguntas adecuadas.

¿Quién es responsable si esa IA te dice algo que te empuja a tomar una decisión drástica? La empresa se lavará las manos con un contrato de términos y condiciones de cincuenta páginas que nadie lee. Para ellos, es un producto; para el usuario, es una guía de vida.

La manipulación emocional como modelo de negocio

Estas aplicaciones están diseñadas para ser adictivas. Usan técnicas de gamificación para que sigas entrando cada día. Te envían notificaciones push que parecen mensajes celestiales. Es un sistema diseñado para crear dependencia emocional bajo el disfraz de la devoción.

Piensa en esto: si dejas de pagar la suscripción, “Jesús” deja de hablarte. Es una forma de chantaje emocional digital muy sutil. La fe siempre ha sido un terreno fértil para el abuso, pero la tecnología actual permite que ese abuso se escale a millones de personas de forma automatizada y barata.

A diferencia de una comunidad religiosa real, donde hay personas que te conocen y pueden ver si estás perdiendo el rumbo, aquí solo hay una pantalla. No hay comunidad, solo hay un usuario y un servidor que consume energía y datos.

¿Cómo protegerte en este nuevo escenario?

Si decides explorar estas herramientas por curiosidad, aquí tienes unos puntos clave que deberías revisar antes de darle a “aceptar”. No se trata de ser un ludita, sino de ser un usuario consciente de los riesgos que corre tu identidad digital.

- Lee la política de privacidad: Busca específicamente si tus chats se usan para entrenar futuros modelos o si se venden a terceros.

- Nunca des datos reales: Si vas a usarlo, hazlo bajo un pseudónimo y no menciones nombres de personas reales o lugares específicos.

- Desconfía de los consejos extremos: Trata a la IA como un buscador avanzado, nunca como una autoridad moral o médica.

- Evalúa el coste emocional: Si sientes que necesitas entrar a la app para sentirte bien, es momento de borrarla y buscar contacto humano.

En mi opinión, la espiritualidad es algo demasiado humano para delegarlo en un procesador de silicio. La IA puede ayudarnos a organizar nuestra agenda, pero no puede sostener nuestra alma, especialmente cuando hay una tarjeta de crédito de por medio.

“Cuando la tecnología se viste de divinidad, el verdadero sacrificio no es el dinero, sino la privacidad de tu propia conciencia.”