El impuesto invisible de la automatización: calibrando el motor de la inteligencia artificial en la oficina.

La narrativa sobre la inteligencia artificial en el entorno laboral ha estado dominada por promesas de eficiencia radical. Los modelos fundacionales, capaces de generar texto, código y análisis a velocidades sin precedentes, han demostrado ser catalizadores de una nueva era. Sin embargo, en el punto de contacto entre la máquina y el escritorio, surge una fricción inevitable: el coste de la verificación. Estamos en la fase donde la IA ya ha entregado un aumento cuantificable de la productividad, pero este beneficio viene acompañado de un ‘impuesto oculto’ que las organizaciones deben aprender a gestionar.

Los datos recientes son claros y a la vez contradictorios. Un 74% de los empleados reporta sentirse significativamente más productivo al integrar herramientas de IA en sus rutinas diarias, logrando ahorrar entre una y tres horas semanales en tareas repetitivas o la generación de borradores. Este es el lado optimista, la confirmación de que el motor de la automatización funciona y está liberando capacidad mental para funciones de mayor valor estratégico.

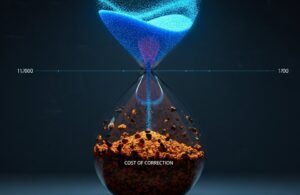

Pero el análisis no puede detenerse ahí. Casi la mitad de esos mismos empleados, un alarmante 42%, confiesa dedicar tiempo a corregir o refinar los resultados entregados por la IA. Este esfuerzo de revisión representa, en muchos casos, la pérdida de hasta el 40% del tiempo originalmente ganado. Hemos intercambiado la lentitud por la necesidad de vigilancia, una vigilancia que, si no se optimiza, neutraliza la propia promesa de la eficiencia.

La Tasa de Aceleración y el Ahorro Cuantificable

La IA ha conquistado nichos de tarea específicos, especialmente aquellos caracterizados por la repetición y la baja ambigüedad contextual. La redacción de correos electrónicos internos, la síntesis de informes largos, la traducción técnica o la generación de código boilerplate son ahora procesos notablemente más rápidos. Para un empleado promedio que dedica 10 horas a la semana a estas tareas, la IA puede reducir este tiempo a 6 o 7 horas, lo que se traduce en un margen de maniobra crucial.

Este es el verdadero punto de inflexión. La IA no está sustituyendo masivamente el juicio humano; está eliminando la parte más tediosa del proceso, aquella que históricamente ha sido la barrera para la creatividad y el enfoque. Es una liberación de recursos cognitivos que, en teoría, deberían ser reorientados hacia la innovación, la estrategia o la interacción humana compleja.

El Costo Marginal de la Confianza: La Corrección como Disciplina

¿Por qué el 42% de los usuarios dedica tiempo a corregir? La respuesta se encuentra en la naturaleza probabilística de los Modelos de Lenguaje Grandes (LLMs). Si bien son extraordinariamente competentes en la generación, aún fallan en tres áreas clave que requieren intervención humana constante:

- La Alucinación (Factualidad): La IA puede generar respuestas plausibles pero falsas o inventar fuentes. La responsabilidad final del dato siempre recae en el humano, forzando una verificación cruzada.

- El Contexto Profundo: Los modelos generales carecen del contexto interno específico de la organización, sus matices culturales o sus datos propietarios, lo que exige ajustes significativos para que el resultado sea utilizable.

- La Pérdida de Tono y Voz: En comunicaciones críticas, el resultado de la IA a menudo requiere una inyección de voz corporativa o sensibilidad emocional que solo la experiencia humana puede proporcionar.

Esta necesidad de auditoría no es una debilidad de los empleados, sino una fase natural de adaptación. Es la curva de aprendizaje que define la transición hacia la co-creación. Sin embargo, si la corrección se convierte en un bucle interminable, el valor estratégico de la IA se disuelve.

El verdadero valor de la IA en la productividad no reside en la velocidad de la generación, sino en la calidad del filtro humano que se le aplica. Corregir no es tiempo perdido; es la inversión necesaria para transformar una sugerencia algorítmica en conocimiento accionable y fiable.

<

El Factor Generacional y la Curva de Dominio

Curiosamente, los datos sugieren que los empleados más jóvenes son quienes más tiempo dedican a la corrección. Esto podría interpretarse de dos maneras, ambas relevantes para la estrategia empresarial. Por un lado, las generaciones que crecieron con la tecnología son más propensas a integrar la IA de forma agresiva en flujos de trabajo menos probados, lo que naturalmente lleva a una mayor tasa de error y corrección.

Por otro lado, esto subraya una deficiencia crítica en la formación empresarial. La habilidad de ‘prompt engineering’ —la ingeniería de peticiones— sigue siendo una competencia incipiente. Muchos usuarios tratan a la IA como un motor de búsqueda sofisticado en lugar de como un compañero de pensamiento que requiere instrucciones precisas y un marco contextual delimitado. Una mejor formación en la formulación de prompts podría reducir drásticamente el tiempo dedicado a la posproducción de resultados.

Estrategia de Futuro: Del ‘Prompt y Revisa’ a la Integración Profunda

El camino hacia la eficiencia neta en el trabajo asistido por IA pasa por minimizar la fricción en la verificación. Esto no significa eliminar al humano, sino redefinir su rol, moviéndolo de corrector de estilo a auditor estratégico.

Históricamente, la adopción de toda tecnología disruptiva ha pasado por una fase inicial de alta inversión de tiempo y recursos para dominar la herramienta. Pensemos en los primeros procesadores de texto o en las hojas de cálculo: el tiempo dedicado a aprender comandos o a depurar macros era alto, pero una vez dominado, el salto de productividad era exponencial. Estamos presenciando esa misma normalización con la IA.

Tres Ejes para Minimizar el Costo de Revisión

Las organizaciones que busquen trascender esta paradoja de la productividad deben centrarse en tres pilares estratégicos que ya están definiendo la vanguardia de la IA empresarial:

- RAG y Contextualización: La implementación de arquitecturas de Generación Aumentada por Recuperación (RAG) permite a los LLMs acceder a bases de datos internas propietarias. Al basar sus respuestas en documentos empresariales verificados, el riesgo de alucinación se reduce drásticamente, haciendo que la revisión se centre menos en la veracidad y más en el enfoque.

- Modelos Especializados (Fine-tuning): En lugar de usar modelos masivos y generalistas, las empresas deben invertir en el ajuste fino (fine-tuning) de modelos más pequeños para tareas específicas (ej., IA para legal, IA para finanzas). Un modelo entrenado en la jerga y los formatos de la empresa es inherentemente más fiable y requiere menos corrección.

- Sistemas de Verificación Automatizada: Implementar sistemas que comparen automáticamente la salida de la IA con fuentes primarias dentro del ecosistema digital de la empresa. Esto traslada gran parte de la corrección básica de un proceso manual a un proceso algorítmico, dejando al humano la tarea de validar el juicio o la estrategia, no la sintaxis o el dato.

Hacia la Eficiencia Netamente Positiva

El desafío del 42% no es un fracaso de la IA, sino un indicio de su madurez. Nos dice que hemos cruzado el umbral de la experimentación y hemos entrado en la fase de ingeniería práctica. El futuro del trabajo no es la automatización total, sino la amplificación de la capacidad humana.

Para Versor, la estrategia es clara: las horas ganadas por la IA no deben verse como tiempo libre, sino como un crédito de juicio. Si una hora se ahorra en redacción de borradores, esa hora debe invertirse en auditar la calidad, refinar la pregunta estratégica o dedicarse a la innovación disruptiva. El camino hacia la verdadera productividad no se mide solo por la velocidad de la máquina, sino por la sabiduría con que aplicamos el filtro humano.

Aprendizajes Clave para el Futuro del Trabajo Aumentado

- La productividad de la IA se mide por la eficiencia neta, restando el tiempo de corrección.

- Invertir en la formación de prompt engineering es tan crucial como adquirir la licencia de software.

- La estrategia RAG y el fine-tuning son las claves para reducir las alucinaciones y el esfuerzo de verificación.

- El rol humano evoluciona de ejecutor a validador de la estrategia y la ética de la IA.