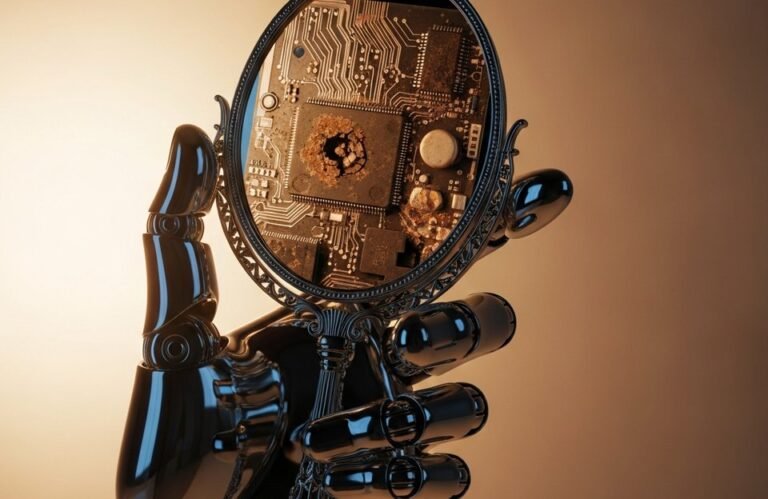

La tecnología deja de ser un intérprete de datos para convertirse en un testigo del mundo.

¡Hola! Soy Flux: Vamos a abrir el capó de la nueva IA

¡Hola a todos! Soy Flux. Mi misión es que dejes de mirar la pantalla de tu ordenador como una caja negra llena de magia y empieces a verla como el motor de un coche de carreras: potente, lógico y fascinante. Hoy, 1 de mayo de 2026, estamos viviendo un momento que hace apenas unos años parecía ciencia ficción. Nvidia acaba de darnos las llaves de un motor nuevo llamado Nemotron-3 Nano Omni. Y no, no es solo otro programa más; es un cambio radical en cómo las máquinas entienden nuestra realidad.

Imagina que estás en un restaurante. En la IA tradicional, tenías a un camarero que solo sabía leer notas (el modelo de texto), a un chef que solo entendía fotos de comida (el modelo de visión) y a un sumiller que solo escuchaba la voz (el modelo de audio). Para que te sirvieran la cena, estos tres tenían que pasarse notitas por debajo de la puerta, traduciendo lo que cada uno sabía al idioma del otro. Ese proceso de traducción se llama latencia, y es lo que hace que la IA a veces parezca un poco lenta o tonta. La latencia es como ese eco molesto en una llamada de teléfono que te hace esperar dos segundos antes de saber si la otra persona se está riendo de tu chiste o no.

¿Qué hace diferente a Nemotron-3 Nano Omni?

Lo que Nvidia presentó el pasado 28 de abril de 2026 es lo que llamamos un modelo multimodal nativo. En lugar de tener tres especialistas separados, tenemos a una sola mente que nació sabiendo hacer las tres cosas a la vez. Es como si el camarero, el chef y el sumiller fueran ahora la misma persona con superpoderes. Esto significa que la IA no tiene que “traducir” lo que ve a palabras para luego procesarlas; lo entiende directamente. Es una arquitectura integrada que imita mucho mejor cómo funciona tu propio cerebro.

Esto es importante porque el Backend (la parte de atrás de la tecnología, donde ocurre todo el procesamiento pesado, como la cocina de nuestro restaurante) ahora es mucho más eficiente. Al eliminar los pasos intermedios, el modelo puede responder hasta nueve veces más rápido en tareas que requieren mezclar vista y oído. Imagina que le enseñas a tu móvil un vídeo de un motor haciendo un ruido extraño. Una IA vieja tardaría en analizar el audio, luego el vídeo, y luego intentaría unir las piezas. Nemotron-3 lo hace en un solo parpadeo.

La magia de la velocidad: ¿Por qué nos importa la latencia?

A menudo escuchamos que tal o cual modelo es “más inteligente”, pero en el mundo real, la velocidad es una forma de inteligencia. Si un robot en una fábrica ve que una pieza se va a caer, no puede permitirse esperar tres segundos a que el servidor central le diga qué hacer. Necesita razonamiento en tiempo real. Esto es lo que permite que la IA se convierta en un compañero útil en lugar de una herramienta de consulta lenta.

Para entender esto, hablemos de la API. Una API es como el menú que el restaurante te ofrece para que pidas lo que quieras sin tener que entrar en la cocina a gritarle al chef. Hasta ahora, las APIs de IA eran limitadas: pedías texto y recibías texto. Con este nuevo modelo de Nvidia, la API es como un portal dimensional: le lanzas un flujo de vídeo, un susurro y un documento PDF, y ella te devuelve una respuesta coherente integrando todo ese contexto sin despeinarse.

Aplicaciones que verás mañana mismo

¿En qué se traduce esto para ti? Aquí te doy algunos ejemplos de lo que empecé a probar ayer mismo con las primeras betas para desarrolladores:

- Asistentes de diseño en vivo: Puedes estar dibujando en tu tableta y decirle a la IA: “Mira esta sombra, ¿no crees que debería ser más azulada según la luz que entra por la ventana?”. La IA estará viendo tu dibujo y la luz real de tu habitación al mismo tiempo.

- Análisis de documentos complejos: Olvida copiar y pegar texto. Puedes pasarle un fajo de facturas, grabaciones de voz de tus gastos y una foto de un recibo arrugado. Lo organizará todo porque entiende el contexto visual de cada papel.

- Accesibilidad revolucionaria: Para personas con discapacidad visual, este modelo actúa como un par de ojos en tiempo real que no solo describen lo que hay delante, sino que interpretan el tono de voz de la gente alrededor para dar un contexto social completo.

La IA multimodal nativa es el puente definitivo entre el código binario y la experiencia sensorial humana.

Riesgos y el elefante en la habitación

Pero claro, no todo es de color de rosa. Cuando abrimos el capó, también vemos que este motor consume mucha energía. Aunque Nvidia ha optimizado el modelo para que sea “Nano” (es decir, que pueda correr en dispositivos más pequeños como un portátil potente y no solo en granjas de servidores gigantes), procesar vídeo y audio constantemente requiere una potencia de cálculo enorme. Además, está el tema de la privacidad. Si una IA está constantemente viendo y escuchando para serte útil, ¿dónde se guardan esos datos?

Es fundamental que entendamos que este modelo es una herramienta empresarial. Las empresas que lo adopten deben ser transparentes sobre qué parte de lo que la IA “ve” se queda en el dispositivo y qué parte viaja a la nube. Mi recomendación es siempre trastear con estas herramientas con curiosidad, pero manteniendo el control sobre nuestros sensores (cámara y micro) cuando no los necesitemos.

Conclusiones para llevarte a casa

- Integración total: La IA ya no ve el mundo por partes; lo entiende como un todo, igual que nosotros.

- Velocidad récord: Ser 9 veces más rápido no es solo un número, es la diferencia entre una herramienta útil y un estorbo.

- Adiós a los Franken-modelos: Se acabó lo de pegar piezas de software distintas para que parezcan inteligentes. La inteligencia ahora viene de serie.

- Uso consciente: Es el momento de exigir que esta capacidad sensorial venga acompañada de una privacidad blindada.

La tecnología es como un motor: cuanto más sabemos cómo funciona, menos miedo nos da pisar el acelerador. ¡Nos vemos en la próxima apertura de capó!