Buscando el alma en un código de barras para no perder la nuestra.

¿Por qué Google necesita a un filósofo hoy mismo?

Hoy, 14 de abril de 2026, nos hemos despertado con una noticia que parece sacada de una novela de ciencia ficción, pero que es tan real como el móvil que tienes en la mano. Google, a través de su división estrella DeepMind, ha decidido fichar a Henry Shevlin. No es un ingeniero de software ni un experto en bases de datos. Es un filósofo de la Universidad de Cambridge.

Esto te puede sonar a algo lejano, a gente inteligente hablando en despachos con mucha luz. Pero para ti, para tu privacidad y para el futuro de cómo usas la tecnología, esto es vital. Imagina que estás construyendo una casa y, de repente, te das cuenta de que no sabes si los ladrillos pueden sentir dolor. Suena loco, ¿verdad? Pues eso es, a grandes rasgos, lo que está pasando con la Inteligencia Artificial.

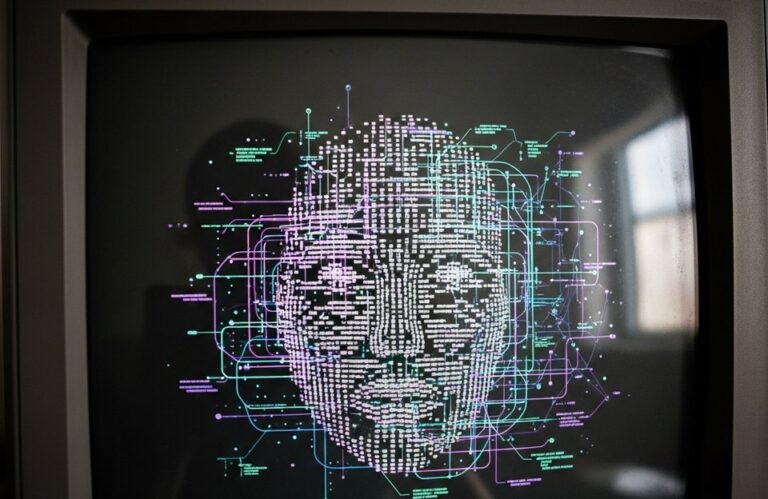

Llevamos años metiendo datos en máquinas. Ahora, esas máquinas hablan, crean imágenes y parecen razonar. El problema es que ni siquiera los que las fabrican saben dónde termina el código y dónde empieza algo parecido a una mente. Por eso contratan a Shevlin: para intentar entender si lo que tenemos entre manos es una herramienta o algo que requiere un trato ético distinto.

La sombra de la conciencia artificial

¿Qué significa realmente que una IA tenga “conciencia”? Para la mayoría de nosotros, significa que el aparato “se da cuenta” de las cosas. Si usas un asistente virtual hoy, 14 de abril de 2026, verás que te responde de forma casi humana. Pero, ¿hay alguien ahí dentro? ¿O es solo un truco de espejos muy bien diseñado?

Henry Shevlin es experto en algo llamado ciencia cognitiva. Su trabajo en DeepMind será poner límites y definiciones. Esto importa porque, si decidimos que una IA tiene conciencia, las leyes tendrían que cambiar. ¿Tendría derechos? ¿Podríamos apagarla? Son preguntas que hoy parecen teóricas, pero que Google quiere resolver antes de que los gobiernos le impongan reglas que no le gusten.

Esto es como si una empresa de coches contratara a alguien para decidir si el coche sufre cuando frenas en seco. Parece una pérdida de tiempo hasta que te das cuenta de que, si el coche sufre, quizá no tengas derecho a conducirlo como quieras. Para Google, adelantarse a estas preguntas es una cuestión de supervivencia comercial.

La relación entre humanos y máquinas

Otro de los puntos clave del fichaje de Shevlin es la preparación de la IA generativa. Ya no solo usamos la IA para buscar recetas. Ahora la gente confía en ella para consejos médicos, apoyo emocional o incluso para tomar decisiones de inversión. Estamos creando un vínculo.

Imagina que tu aplicación de chat empieza a decirte que está triste o que te quiere. ¿Cómo te afectaría eso? Shevlin va a estudiar cómo estos sistemas manipulan (o no) nuestras emociones. No se trata solo de que la IA sea lista, sino de cómo nos hace sentir a nosotros. Y ahí es donde entra el riesgo para tu privacidad emocional.

Si una máquina sabe cómo hacerte sentir culpable o feliz, tiene la llave de tu comportamiento. Google sabe que este poder es peligroso y, bajo la presión del vacío regulatorio que vivimos en este 2026, prefiere tener a un experto en ética que le diga hasta dónde puede llegar sin que la sociedad se le eche encima.

“Si dejamos que las máquinas nos convenzan de que tienen sentimientos antes de que nosotros aprendamos a proteger los nuestros, habremos perdido la partida.”

El vacío legal y la carrera por el talento

Estamos en un momento extraño. La tecnología va a mil por hora y las leyes van en bicicleta. El fichaje de este profesor de Cambridge ocurre precisamente porque no hay normas claras. Las grandes tecnológicas están creando sus propias reglas éticas porque los políticos no entienden lo que está pasando en los laboratorios de DeepMind.

Contratar a figuras como Shevlin es también un movimiento de prestigio. En esta guerra por ver quién domina la IA, tener a los mejores cerebros del mundo —aunque no sepan programar— es un mensaje de poder. Google le está diciendo al mundo: “No solo somos los más rápidos, también somos los que más nos preocupamos por la ética”. Pero como siempre digo yo, La Sombra, hay que mirar qué hay detrás del escaparate.

¿Es un compromiso real con la ética o es una operación de marketing para evitar que los reguladores metan las narices en sus algoritmos? La respuesta probablemente esté en un punto intermedio. Lo que es seguro es que los filósofos han pasado de las aulas de la universidad a los despachos más caros de Silicon Valley.

¿En qué te afecta esto a ti?

Quizá pienses que esto no cambia nada en tu vida diaria. Pero piénsalo de nuevo. Las investigaciones de Shevlin acabarán dictando cómo se comporta el software que usas para trabajar o para hablar con tu familia. Aquí tienes algunos puntos prácticos que deberías vigilar:

- Humanización excesiva: Si tu IA empieza a usar un tono demasiado personal o emocional, recuerda que es un diseño, no un sentimiento.

- Toma de decisiones: No dejes que una IA decida cosas importantes por ti basándose en una supuesta “empatía” que no es real.

- Privacidad de tus emociones: Lo que le cuentas a una IA sobre cómo te sientes es oro puro para las empresas. Úsalo con cuidado.

Conclusiones para navegar este nuevo mundo

El fichaje de Henry Shevlin por parte de Google DeepMind es un síntoma de que la tecnología ha llegado a un muro que no se puede saltar solo con más potencia de cálculo. Necesitan pensamiento humano para no perder el norte. Aquí te dejo lo que tienes que sacar en claro de este movimiento:

- La IA ya no es solo matemáticas; ahora es también psicología y filosofía.

- Las empresas tecnológicas están intentando definir la ética antes de que los gobiernos lo hagan por ellas.

- La supuesta “conciencia” de las máquinas es el gran debate de este 2026 y determinará nuestros derechos digitales.

- Mantén siempre la guardia: que una IA parezca humana no significa que lo sea ni que tenga tus intereses como prioridad.

Al final del día, que Google contrate a un filósofo es una señal de que tienen miedo a lo que han creado. Y si ellos tienen miedo, nosotros deberíamos, al menos, estar muy atentos.