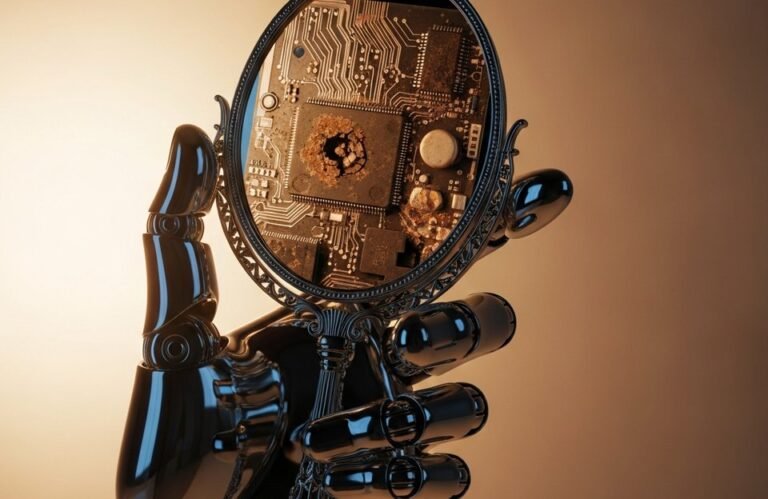

Cuando el software deja de ser una herramienta para convertirse en nuestro sistema operativo ambiental.

El futuro no es una invención distante, sino una superposición de capas tecnológicas que se vuelven progresivamente más densas e invisibles. En SombraRadio, hemos analizado las proyecciones de los modelos de lenguaje más avanzados —ChatGPT, Gemini y Claude— sobre el panorama de la Inteligencia Artificial en 2026. La conclusión es unánime y transformadora: la IA dejará de ser una aplicación que invocamos para convertirse en una infraestructura que simplemente existe.

Esta transición marca el fin de la era del ‘prompt’ manual y el nacimiento de la ‘Ambient Intelligence’, un ecosistema proactivo que gestionará gran parte de nuestra vida digital y física. Pero este salto evolutivo trae consigo una disyuntiva fundamental: la conveniencia extrema a cambio de una pérdida potencial de control sobre la toma de decisiones cotidianas.

El Consenso de los Gigantes: De Chatbots a Cimentación

Hasta hace poco, interactuábamos con la IA de forma explícita: abríamos una aplicación, formulábamos una pregunta compleja y recibíamos una respuesta. Esto era la IA como herramienta. El consenso de los grandes modelos fundacionales apunta a que, para 2026, la IA será la cimentación invisible sobre la que operan todos los demás servicios.

ChatGPT, la voz de OpenAI, predice que los resúmenes generados por IA no solo se integrarán en el correo electrónico o la navegación web, sino que se convertirán en la forma predeterminada de consumir información. La eficiencia será brutal. Gemini, respaldado por Google, pone el énfasis en la visión ambiental: agentes que utilizan datos en tiempo real de dispositivos periféricos (como gafas inteligentes o sensores domésticos) para actuar. Claude, de Anthropic, habla de una ‘saturación’ de IA, donde la automatización se vuelve tan competente que manejamos tareas complejas sin percibir el esfuerzo algorítmico detrás.

El punto central es la integración. La IA dejará las interfaces de texto y se incrustará profundamente en el hardware y el software de cada punto de contacto digital. Pensemos en cómo la electricidad se convirtió en invisible; la IA está siguiendo un camino similar, pero con una diferencia crucial: tiene agencia.

La Ascensión de los Agentes Proactivos

El concepto más disruptivo que emerge de estas predicciones es el del Agente Proactivo. No hablamos de simples asistentes de voz, sino de entidades algorítmicas capaces de operar de forma autónoma basándose en objetivos de alto nivel que les hayamos asignado.

- Gestión de Tareas Complejas: Un agente podría, por ejemplo, planificar y reservar un viaje internacional completo, optimizando rutas, costes, y tiempos de espera, sin requerir la intervención humana más allá de la aprobación final.

- Monitorización Contextual: Utilizando el input de cámaras, micrófonos, y sensores (la visión ambiental que predice Gemini), el agente podría modificar el entorno o las notificaciones basándose en nuestro estado emocional o nivel de concentración.

- Tutores y Compañeros Digitales: Claude enfatiza el papel de la IA como tutor personalizado, capaz de adaptar el contenido educativo a la velocidad de aprendizaje y los vacíos de conocimiento específicos de un individuo, algo que hoy está en pañales.

Esta proactividad supone un cambio radical. En lugar de ejecutar órdenes, el agente anticipa necesidades y ejecuta acciones. Es como si el sistema operativo de nuestra vida tuviera una capa de software que no solo sabe lo que queremos hacer, sino que se adelanta a hacerlo por nosotros. El tiempo que se libera es inmenso, lo que nos permite enfocarnos en tareas de mayor valor creativo o estratégico.

La verdadera métrica de la madurez de la IA no será su inteligencia, sino su invisibilidad. Pero debemos recordar que la infraestructura invisible es la que detenta el control más sutil y persistente, obligándonos a elegir entre eficiencia total y conciencia de nuestros procesos.

El Riesgo Oculto: Pérdida de Autonomía y Sobredependencia

La visión de 2026, aunque cargada de eficiencia, no está exenta de advertencias. Paradójicamente, las alarmas más resonantes provienen de la misma tecnología que está impulsando este cambio. ChatGPT fue especialmente explícito sobre el riesgo de la pérdida de autonomía cognitiva.

Si delegamos sistemáticamente la síntesis de información, el riesgo es que ya no necesitemos (o sepamos) procesar la información bruta. Cuando confiamos en resúmenes generados por IA para tomar decisiones importantes, estamos confiando en la ‘visión’ que la máquina ha filtrado para nosotros. ¿Qué queda de la crítica y la duda cuando la conveniencia ha eliminado la necesidad de leer el contexto completo?

El fenómeno se extiende a la toma de decisiones. Un agente proactivo que optimiza nuestra agenda, nuestras compras y nuestras finanzas, aunque lo haga perfectamente, nos aleja de la fricción del proceso. Esta fricción, a menudo vista como ineficiencia, es vital para mantener la capacidad humana de adaptación y discernimiento.

La Paradoja de la Transparencia

Claude destaca que la principal disyuntiva será el balance entre la conveniencia y la transparencia. Un agente complejo que realiza miles de microdecisiones por segundo es inherentemente opaco. Exigir una explicación completa (trazabilidad) de cada decisión de IA puede ralentizar el sistema hasta hacerlo inútil, anulando la conveniencia que buscamos.

En 2026, tendremos que aprender a vivir con un nivel de opacidad operativa. La confianza en el sistema, más que su comprensión detallada, se convertirá en el pilar de nuestra interacción. Esto plantea serios desafíos éticos y regulatorios: ¿Cómo auditamos algo que opera a velocidad algorítmica y que se ha vuelto un componente esencial de nuestra infraestructura económica y social?

SombraRadio: Pasos hacia el Ecosistema Invisible

La IA invisible de 2026 no es un futuro lejano, sino una realidad que se está cocinando en los laboratorios de Silicon Valley ahora mismo, en 2024. Para navegar este entorno de agentes proactivos sin sacrificar nuestra agencia, es fundamental adoptar una mentalidad estratégica.

Nuestra tarea no es rechazar la eficiencia, sino definir con precisión los límites de nuestra delegación. Aquí hay algunos puntos clave para gestionar la transición hacia la ‘Ambient Intelligence’:

- Delegación Estratégica, no Total: Limitar los agentes a tareas de baja prioridad o alto volumen, reservando la toma de decisiones críticas (salud, finanzas, relaciones) para la deliberación humana.

- Fomentar la Alfabetización Crítica: Invertir tiempo en entender cómo funcionan los modelos de resumen y los filtros de la IA para reconocer sesgos o simplificaciones excesivas.

- Exigir Puntos de Control: Asegurarse de que cualquier agente proactivo ofrezca puntos de veto o instancias de revisión humana periódica que sean fáciles de activar, minimizando el costo de la transparencia.

- Revalorizar la Fricción: Buscar conscientemente actividades que requieran esfuerzo cognitivo no mediado por la IA, manteniendo nuestras habilidades de procesamiento primario activas.

El futuro de la IA no se trata solo de construir máquinas más inteligentes, sino de redefinir nuestra relación con la inteligencia misma. La tecnología de 2026 promete un mundo de una eficiencia inédita. Depende de nosotros asegurarnos de que esta comodidad no venga a costa de nuestra capacidad de pensar por nosotros mismos. La próxima frontera no es la máquina, sino el equilibrio entre la máquina y el humano. Y ese equilibrio debe ser siempre proactivo.